“Hey ChatGPT,帮我写一份工作日报。”——如果你觉得这只是科幻片台词,2025年6月的AI语音助手已经将它变成现实。

GPT-4o 的推出标志着OpenAI正式进军语音对话助手领域,其自然语音识别与语气反应能力让人惊艳。以下是目前语音AI领域的最新进展与实际应用体验。

✅ GPT-4o语音模式:更像“人”而不是“导航仪”

OpenAI 于 2024 年底发布的 GPT-4o 模型,不仅提升了文本理解力,更重要的是:

- 支持实时语音输入与语音输出

- 具备多轮语音对话记忆能力

- 声音自然、有情感、有停顿节奏

体验者表示:“就像和一个冷静聪明的人类助手对话,甚至能听出它在‘思考’。”

📌 示例应用:用语音让它查资料、写文案、翻译、规划行程、讲睡前故事,几乎都能流畅完成。

✅ 多模态AI助手生态正在形成

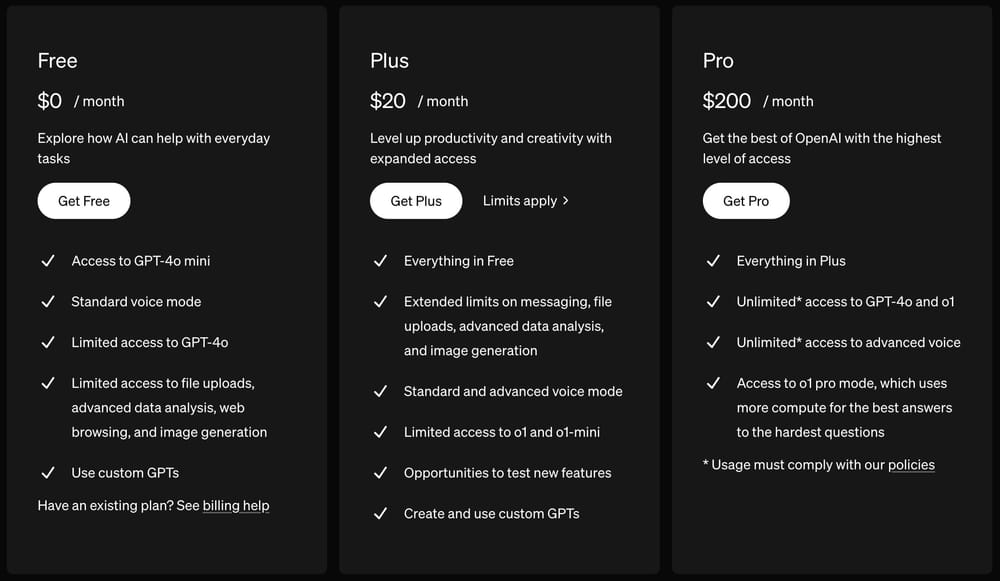

不仅是OpenAI,其他科技公司也在发力:

| 公司 | 模型/产品名称 | 特点 |

|---|---|---|

| OpenAI | GPT-4o | 可语音对话、多语言、语音语调强 |

| Gemini 1.5 | 语音识别快,整合Android生态 | |

| 苹果 | Siri(将整合GPT) | iOS系统级语音助理焕新中 |

| 科大讯飞 | 星火大模型 | 中文语音识别强,接地气 |

| 阿里通义 | 通义听悟 | 更适合会议记录、中文速记 |

🎯 GPT-4o 是目前语音交互中“最拟人”的存在之一,特别在英语语境下表现更强。

✅ 使用场景快速扩展中

- 日常对话助手:代替打字提问,如“GPT,今天杭州天气如何?”

- 办公命令执行:快速记录备忘、生成邮件草稿、会议纪要整理

- 学习与陪伴:为学生讲解概念、做英语口语陪练、讲故事

- 无障碍辅助:为视力障碍者、行动不便者提供语音交互入口

✅ 语音AI的挑战:中文适配与设备整合

虽然GPT语音助手强大,但目前中文环境下仍存在:

- 语音识别准确率偶有错误(尤其在方言、术语场景)

- 对语调、语气变化的理解仍待提升

- 在国内,访问GPT语音功能仍需科学上网或使用镜像平台

🎯 未来趋势将是语音与手机App、车载系统、耳机设备的深度融合。

✅ 结语:语音GPT不是未来,而是正在发生

你可以用嘴“提问”,AI就能听懂、理解并回答——而且回答越来越自然、智能、有温度。

2025年的语音助手,已不只是机械的指令执行工具,而开始成为懂你、听你、会思考的伙伴。